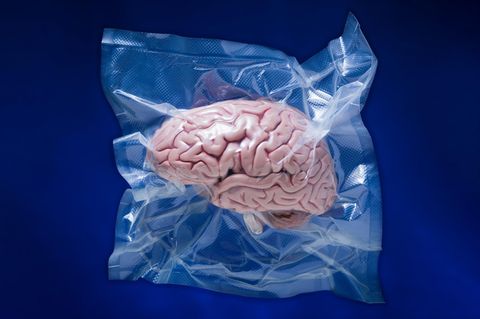

Forschenden des Massachusetts General Hospital ist es gelungen, die Sprachproduktion im Gehirn auf neuronaler Ebene exakt nachzuverfolgen. Ihre im Fachmagazin "Nature" publizierte Studie liefert eine detaillierte Karte davon, wie Sprachlaute, etwa Konsonanten und Vokale, im Gehirn repräsentiert werden, noch bevor sie überhaupt gesprochen werden.

Dazu setzten sie eine hochentwickelte Methode zur Gehirnaufzeichnung ein: Sogenannte Neuropixel-Sonden zeichneten die Aktivitäten einzelner Neuronen im präfrontalen Kortex auf, einer Frontalregion des menschlichen Gehirns. Die Forschenden identifizierten einzelne Hirnzellen, die an der Sprachproduktion beteiligt sind. Sie fanden auch heraus, dass es im Gehirn getrennte Gruppen von Neuronen gibt, die für das Sprechen und für das Zuhören zuständig sind. Diese Zusammenarbeit von Neuronen ermöglicht es Menschen, ihre Gedanken in Worte zu fassen und sie anschließend verbal zu artikulieren.

Technologischer Durchbruch der neuronalen Aufzeichnung

"Obwohl Sprechen normalerweise einfach zu sein scheint, führt unser Gehirn viele komplexe kognitive Schritte bei der Produktion natürlicher Sprache aus – einschließlich der Formulierung der Wörter, die wir sagen möchten, der Planung der Artikulationsbewegungen und der Produktion der beabsichtigten Lautäußerungen", sagt der leitende Studienautor Ziv Williams, Neurochirurg an der Harvard Medical School. "Unser Gehirn führt diese Leistungen überraschend schnell aus – bei natürlicher Sprache etwa drei Wörter pro Sekunde – und mit bemerkenswert wenigen Fehlern. Doch wie uns dieses Kunststück genau gelingt, war lange Zeit ein Rätsel."

Die am Massachusetts General Hospital entwickelten Neuropixel-Sonden, die Freiwilligen in das Gehirn eingeführt wurden, sind dünner als ein menschliches Haar. Trotzdem verfügen sie über Hunderte von Kanälen, die in der Lage sind, gleichzeitig die Aktivität von Dutzenden oder sogar Hunderten einzelner Neuronen aufzuzeichnen. Damit können diese Sonden Erkenntnisse liefern, wie Neuronen kollektiv agieren und zusammenarbeiten, um komplexe Verhaltensweisen wie Sprache hervorzurufen.

Einzelne Sprachelemente können entschlüsselt werden

Demnach repräsentieren einzelne Neuronen grundlegende Elemente, die an der Konstruktion gesprochener Wörter beteiligt sind, von einfachen Sprachlauten, sogenannten Phonemen, bis hin zu deren Zusammenfügung zu komplexeren Zeichenfolgen wie Silben. Der Konsonant "da", der entsteht, wenn die Zunge den harten Gaumen hinter den Zähnen berührt, wird beispielsweise benötigt, um das Wort "Dog" zu bilden.

Die Forschenden fanden zudem heraus, dass bestimmte Neuronen aktiv werden, bevor ein Phonem laut ausgesprochen wird. Andere Neuronen wiederum spiegelten komplexe Aspekte der Wortkonstruktion wider, so etwa die spezifische Anordnung von Phonemen zu Silben. Damit konnte nachgewiesen werden, dass es möglich ist, die Sprachlaute von Personen zuverlässig zu bestimmen, bevor diese sie überhaupt artikulieren.

Prothesen und Gehirn-Maschine-Schnittstellen

Mit anderen Worten: Forschende können vorhersagen, welche Konsonanten- und Vokalkombination erzeugt wird, bevor die Wörter tatsächlich gesprochen werden. Diese Fähigkeit ließe sich nutzen, um Prothesen oder Gehirn-Maschine-Schnittstellen zu bauen, die eine synthetische Sprache erzeugen.

Das könnte Menschen mit Sprachstörungen helfen. Etwa jenen, die von neurologischen Erkrankungen wie einem Schlaganfall, traumatischen Hirnverletzungen, Tumoren oder neurodegenerativen Erkrankungen betroffen sind. "Wir hoffen, dass ein besseres Verständnis der grundlegenden neuronalen Schaltkreise, die Sprache ermöglichen, den Weg für die Therapien von Sprachstörungen ebnen wird", sagt der Neurochirurg Arjun Khanna, ein Mitautor der Studie.

Die Forschung zielt damit in eine andere Richtung als der Gehirnchip, den das Start-up-Unternehmen Neuralink von Elon Musk kürzlich erstmals einem Patienten eingesetzt hat. Dieser soll es etwa Menschen mit Querschnittlähmung ermöglichen, mithilfe ihrer Gedanken ein Smartphone und andere technische Geräte zu steuern.